作者:周葆华 罗沛 发布时间:2025-03-20 14:23:24 来源:《新闻大学》2024年第6期+收藏本文

摘要:人们通常将某一类性别占主导的职业与该性别联系在一起。在算法得到广泛应用的今天,这种刻板印象从社会数据进入算法,并在算法与用户交互的界面被呈现为偏见。本文关注中国本土的搜索引擎,通过搜索获取搜索引擎中不同排序的图片,将搜索引擎图片与人口普查数据中的职业性别比例进行对比,展开算法审计。研究发现,两个主要搜索引擎的图片搜索结果中都存在符合职业性别刻板印象的性别比例夸大现象,且这种夸大现象在女性占比较低的职业中更加明显;同时,二者都存在职业女性整体占比偏低的情况。在搜索结果排序中,有的搜索引擎靠前图片中刻板印象的比例夸张更严重。搜索算法吸收着职业性别刻板印象且直观地呈现在图片搜索结果中,并可能在算法和用户的认知循环之间进一步加深。

关键词:搜索引擎;职业性别;刻板印象;算法偏见;算法审计

人们常将性别与该性别占主导的职业联系在一起,对职业形成性别化的刻板印象。这种职业性别刻板印象存在于我们的观念中,也长期被呈现在媒体内容中。随着算法被应用于网络平台并重构我们的日常生活(Beer,2009),算法中存在的偏见(偏向,bias)问题也逐渐受到关注。在用户、数据和算法互动的复杂过程中,刻板印象可能通过训练数据及用户行为进入算法,并经由算法再次展示给用户。既往研究发现搜索引擎图片搜索结果可能延续现实中的性别刻板印象(Kay et al.,2015;Metaxa et al.,2021),但这些有限的研究多集中于西方社会场景和个别搜索平台(如谷歌)。本文聚焦国内的搜索引擎百度与搜狗,通过跨平台的算法审计(algorithm auditing)研究探讨如下问题:以普查数据的不同职业性别占比为基准,图片搜索结果中是否存在职业性别刻板印象?两大搜索引擎之间又有何不同?由于人们通常只会关注搜索结果中排序靠前的内容,本文进一步对比处于搜索结果排序不同位置的图片呈现的性别刻板印象状况是否存在差异?通过这样的实证分析,本研究有助于丰富中国本土的搜索引擎算法审计研究,并对理解算法时代的职业性别刻板印象这一事关性别平等与公正的重要议题提供启示。

一、文献综述与研究问题

(一)职业性别刻板印象

李普曼在《舆论》中提出刻板印象(stereotype)的概念,指出人们希望获得事物显著、稳定的属性,对事物的印象通常是“先定义后理解”(李普曼,2018:67),以简单的概括性符号来划分群组、进行社会分类,从而便利理解与交流。因此,人们会以某些外部特征为依据将他(她)人划入不同类型,再用关于这一类型的人的刻板印象去填充他(她)人的形象。刻板印象意味着对不同群体的成见,在社会心理学中被视为一种特定认知结构,在社会层面上,这种简单化的联想可能成为一种集体认知,也是社会性偏见的认知构成(Fiske,2018)。

作为一种典型的刻板印象,性别刻板印象认为某些特定属性区分了男性和女性(Ashmore & Del Boca,1981)。Deaux与Lewis(1984)具体指出性别刻板印象可以分为体征、性格特点、角色行为和职业地位四个部分,每个部分都有男性化和女性化的划分。在职业方面,特定职业被认为由特定性别主导,存在“男性的”(masculine)或“女性的”(feminine)职业区分,而不论其实际构成如何(Oppenheimer,1968)。本文中“职业性别刻板印象”(occupational gender stereotypes)指将性别与该性别占主导的职业联系在一起的观念。Shinar(1975)开始考察人们的主观印象,通过调查得出了129种职业的男性化、女性化或是中性的评分均分,并发现自我报告主观印象中的职业性别标签与现实职业中的主导性别一致,如护士、接待员、秘书等向来被视为女性化的职业,而维修工、机械操作员、船长等则被视为男性职业,尽管这些职业实际上包括了不同性别的从业者。此后心理学研究中也常常通过量表调查测试职业性别刻板印象,并逐渐关注自我报告以外的隐性刻板印象(如使用内隐联想测验方法)(White & White,2006)。

职业性别刻板印象可能影响社会对职业中不同性别的态度,如认为女性化的个性和特征在女性占主导的职业中对成功更加重要(Cejka & Eagly,1999);女性在男性主导职业中的发展存在隐形天花板,而男性在女性主导职业中有着隐形晋升阶梯(Williams,1992)。这些观念也会作用于人们的职业选择并进一步影响其职业生涯,Reskin与Hartmann(1986)指出,工作中的性别隔离可能源于对男女性别内在特征及其社会角色的差异信念,而既有的职场性别隔离又反过来可能导致职业性别刻板印象的进一步加强,影响职业选择;性别角色与职业性别类型不匹配的个人将遭遇更多性别角色冲突(Luhaorg & Zivian,1995);职业性别刻板印象影响女性对女性职业的喜好,是女性继续从事传统职业的原因之一(Oswald,2008)。因此,职业性别刻板印象在社会中的延续会限制和束缚劳动发展的可能性,对个人与社会发展带来不利影响。

刻板印象意味着依照简单符号特征产生分类与联想的固定认知,媒介内容则会反映或再现这种认知。传播研究很早关注报纸、电视等大众媒体中的性别刻板印象,并认为媒体内容的偏向可能导致刻板印象在社会中流行(McArthur & Resko,1975;Manstead & McCulloch,1981)。在职业性别刻板印象方面,Signorielli和Kahlenberg(2001)发现电视中已婚女性角色的职业更加符合刻板印象中的女性职业。Gaucher等(2011)发现,在招聘广告中某性别占主导的职业中更容易出现体现该性别传统特质的性别化用词。Collins(2011)发现媒介中女性代表性不足,且通常被描绘为非职业人士的角色,如家庭主妇、妻子或母亲。Jacobs等(2015)对黄金档电视节目的分析发现,已知职业的电视角色中超过四分之三为男性。刘伯红和卜卫(1997)对中国电视广告中的女性形象研究发现,在当时可以辨别职业的女性中50%以上为家庭妇女,作为领导、管理者和体力劳动者的女性占比都低于0.1%。在互联网出现后,也有研究分析社交平台上特定职业(如内容创作者)的女性形象呈现(Wotanis & McMillan,2014;Döring & Mohseni,2019),但此时媒介刻板印象的基础运作逻辑已经发生了重要转变——算法作为新型技术行动者在生产职业性别刻板印象中扮演重要角色。

(二)算法与刻板印象

与互联网发展早期的Web1.0形态(如网页)不同,搜索引擎、社交媒体等Web2.0数字平台广泛使用推荐算法与用户互动。算法并非仅是计算机科学意义上将输入转换为输出的软件实体或计算过程,而是嵌入平台企业、社会文化以及用户使用的异质化情境中的建构性逻辑(Cellard,2022)。它不像传统媒体那样自身扮演生产者,而是从各类信息来源和用户日常生活中获取数据,继而通过自动化的筛选、排序与组织机制,很大程度上决定我们能看见什么(Bozdag,2013),参与构建我们的生活(Beer,2009)。

与人类相比,算法看似基于高度理性的计算,预测效率更高,通常也更准确(Mayson,2018)。然而算法并不一定比人类更加客观公正,许多情况下,算法输出可以反映、加剧甚至引起刻板印象与社会偏见(Jürgens & Stark,2017)。在社会心理学中,偏见/偏向(bias)被概念化为认知层面的刻板印象(stereotype)、情感层面的情绪性偏见(prejudice)和行动层面的歧视(discrimination)三个部分(Fiske,1998;Fiske,2018;Cuddy et al.,2007)。因此,被更广使用的算法偏见/偏向(algorithmic bias)概念包含其蕴含的刻板印象层面。在算法得到广泛应用前,Friedman和Nissenbaum(1996)曾将计算机信息系统的偏向定义为系统性、不公平地偏袒或歧视某些个人或群体。大众媒体的内容倾向或许源于社会文化塑造下媒体工作者的选择,算法的偏向则具有更复杂的机制。算法“认知”过程被视为黑箱(black box),它可能会从训练数据和人类反馈中习得刻板印象。技术系统中的刻板印象通常表现为概念或特征的关联,例如词共现(co-occurrence)关系(Le Pelley et al.,2010)。Mehrabi等(2021)分析机器学习过程中的偏向,指出从数据到算法、从算法到用户、再从用户日常行为到数据生成的三个环节中都可能产生算法偏向。在这个不断循环往复的过程中,社群特征可能在转化为数据时得到简化与强化,类别间陈规定型的关联成为算法选择和判断的依据;而算法反映的刻板印象结果也可能影响用户,并随着用户行为再次被算法“学习”。

算法偏向通常只能通过结果进行检验,即算法输出结果折射出针对特定个体或群体的刻板印象、偏见或歧视(Mehrabi et al.,2021)。例如,实证研究发现,不利于弱势群体的刻板印象广泛存在于排序算法、社交平台推荐算法之中(Bol et al.,2020;Fabris et al.,2020),搜索算法的搜索结果中包含职业性别刻板印象(Kay et al.,2015),将不同性别分别与“温暖”或“能力”特质关联(Otterbacher et al.,2017),呈现两性不同的性化程度(Ulloa et al.,2022)等。参照这一逻辑,本文主要检验从算法到用户这一过程中可见的算法偏向,主要包括呈现偏向(presentation bias)和排名偏向(ranking bias)(Mehrabi et al.,2021)。其中,前者意味着信息呈现带来的结果偏向(呈现部分内容而非其他内容),后者则强调算法排名问题(排名靠前的结果通常吸引更多的点击,因此其偏向性更值得关注)。特别地,我们将超越文本,聚焦相对更少研究的图片,关注中国主要搜索引擎的图片结果中反映的职业性别刻板印象。

(三)搜索引擎图片中的职业性别刻板印象

搜索引擎被视为选择、分类和分发内容的“看门人”之一(Jürgens & Stark,2017),是用户在网络上有目标地获取信息的重要平台(CNNIC,2024)。其算法主要有过滤和排序两个功能:一方面将一些网页内容排除在搜索结果外,另一方面决定将搜索结果以什么样的顺序呈现于用户面前(Steiner et al.,2022)。

搜索引擎结果中存在着算法偏向,特别是呈现偏向和排名偏向。例如,针对搜索引擎链接内容的实证研究发现:搜索引擎对美国等部分国家网址的覆盖率高于其他国家(Vaughan & Thelwall,2004),倾向于呈现大型商业网站、特定国家(如美国)和语言(如英语)的网站(Van Couvering,2010),以及在中国场景下倾向于呈现来自与搜索引擎相同利益主体网站的信息(师文、陈昌凤,2022)。搜索引擎搜索栏的自动补全功能也可能延续刻板印象,如Baker和Potts(2013)指出谷歌搜索自动补全建议的词汇中存在将特定人种与特定特征联系的刻板印象;对于女性、老年、农村户口三个属性的群体,自动补全算法返回了显著更多的偏向性内容,例如将女性与做家务联系起来的刻板印象(塔娜、林聪,2023)。

性别刻板印象同样呈现在搜索引擎的图片搜索结果中。Otterbacher等(2017)发现,在必应搜索中使用温暖感性的形容词更容易出现女性结果,而表示外在能力特征的形容词则更容易出现男性结果。Noble(2018)发现,谷歌搜索不仅存在明显的性别词语偏向(如搜索“美丽”“丑陋”等外貌形容词更容易出现女性图片),而且呈现出针对特定种族的性化特征偏向——在输入“黑人女孩”时,出现的首页图片结果几乎全是身着比基尼、突出性感特质的黑人女性。Ulloa等(2022)分别使用性别中性词(如“人”)与对应性别化用词进行搜索,发现搜索中性词的图片结果中男性占比更大,且图片中男性的面部与身体比例普遍比女性更高,折射出女性更加被性化的偏向。Vlasceanu和Amodio(2022)通过“人”等关键词在不同国家的搜索也发现搜索结果中男性占比与当地性别不平等程度正相关。

Kay等人(2015)的研究集中关注谷歌图片搜索中各职业性别比例的差异。她们的研究对比职业搜索词的图片搜索结果中的性别比例与社会调查数据中的比例,发现存在女性代表性系统性偏低的情况,同时也存在符合刻板印象的夸大职业性别比例的情况——即夸大现实中男性占比高的职业中的男性占比,以及现实中女性占比高的职业中的女性占比。Metaxa等人(2021)以新的数据重现了Kay等人(2015)的研究,发现2020年谷歌搜索图片中依然存在女性代表性不足和按刻板印象夸大性别占比的现象,且没有证据表明结果较2015年有所改善。

图片可以更加直观地呈现刻板印象,但总体上对于搜索引擎图片中存在职业性别刻板印象的实证研究相对较少,且主要集中于西方社会语境和个别搜索平台。因此,本文希望聚焦中国的搜索引擎,探索图片搜索结果是否反映了职业性别刻板印象,即通过与人口普查基准数据的比较,检验其是否夸大特定性别占主导的职业中该性别的比例,以及是否存在女性占比系统性偏低的状况。首先,本文提出如下研究假设:

假设1:图片搜索结果存在对特定性别占主导职业中该性别比例的夸大。

假设1.1:对于现实中男性占主导(占比大于50%)的职业,图片搜索结果中的女性占比低于普查数据中的女性占比。

假设1.2:对于现实中女性占主导(占比大于50%)的职业,图片搜索结果中的女性占比高于普查数据中的女性占比。

假设2:图片搜索结果中的职业女性整体占比低于人口普查数据中的职业女性占比。

不同搜索引擎在政经和文化控制影响下,可能运用不同算法,带来不同的搜索结果(Van Couvering,2010;Jiang,2014)。不同搜索引擎反馈的结果中重叠率不高,意味着单一搜索引擎覆盖率较低(Spink et al.,2006)。因此,本文将中国两个主要搜索引擎的图片搜索结果进行对照,以期超越现有研究的单一平台倾向,通过跨平台分析更全面地反映不同搜索引擎图片结果中的职业性别比例分布。所选择的搜索引擎包括百度和搜狗,二者占中国搜索引擎市场份额超过65%[1]。由于缺乏内部的算法逻辑来指引假设,本文提出如下研究问题:

研究问题1:两个搜索引擎的图片搜索结果在夸大特定性别占主导职业中该性别比例,以及低度呈现女性方面存在怎样的差异?

搜索引擎结果中的刻板印象不仅在于内容呈现,还在于其排序。排名靠前的内容通常更容易被用户看见,因此更值得关注。Jansen与Spink(2006)指出,用户一般只看搜索结果的第一页,非必要不会点击翻页;Pan等(2007)发现,人们更信任被谷歌排在高位的搜索结果,且常常只点击第一个结果;Chitika(2013)也发现,谷歌90%以上的点击集中在搜索结果的第一页。对图片搜索结果而言,每一页会呈现一定数量的图片,并需要通过滑动进入下一页。Xie等(2017)对图片搜索页面的实验研究表明,用户依然最先关注前排结果并左右移动目光。因此,本研究希望进一步对比搜索结果中得到更多关注的靠前图片和后续更多图片中是否存在职业性别比例分布的差异,提出如下研究问题:

研究问题2:图片搜索结果中首页附近(前20位)与后续更多图片(前50位或100位)中的职业性别刻板印象(夸大特定性别占主导职业中该性别的比例,以及低女性比例)是否存在差异?

二、研究方法

本研究通过算法审计(algorithm auditing)方式探索搜索引擎图片结果中是否存在职业性别刻板印象。“审计”是指研究人员通过类似自然实验的方式参与到他们怀疑有问题的社会过程中,从而诊断歧视或其他有问题的行为(Sandvig et al.,2014)。算法审计即针对算法系统的偏见、歧视、误判等问题进行发掘与诊断的方法(Bandy,2021)。Sandvig等(2014)根据研究者、算法系统与用户三者的关系,将算法审计的设计方式归纳为代码审计(code audit)、非侵入式用户审计(noninvasive user audit)、抓取审计(scraping audit)、傀儡(马甲)账号审计(sock puppet audit)以及众包或协作审计(crowdsourced/collaborative audit)五类。其中,抓取审计(scraping audit)是指研究者不需与用户接触,而通过直接对算法系统施加操作(如发出搜索请求)获取输出结果而展开的审计,已被广泛应用于算法审计研究中(如Fischer et al.,2020)。本文采取这种方式审计搜索引擎图片结果中存在的职业性别刻板印象问题,即通过图片搜索测试对比图片结果中各职业的性别比例,并和人口普查数据中的各职业性别比例比较。

为避免个性化影响,研究在谷歌浏览器中退出浏览器账号后采用隐身模式进行图片搜索,在百度图片和搜狗图片的网页搜索各职业名称。收集搜索结果中的图片后,按图片搜索结果呈现的排序保存,对图片进行职业编码并计算各职业的性别比例,并将该结果与普查数据中的性别比例进行对比分析,通过差异检验和模型拟合研究其中是否存在性别刻板印象。

(一)数据收集

由于第七次人口普查公开数据仅限于较为宽泛的职业分类,无法提供具体职业及其性别比例,本文采用第六次人口普查数据中“全国分性别、职业小类、周工作时间的正在工作人口”一项[2],计算各细分职业性别比例。

普查数据的统计分类采用的是人力资源和社会保障部制定的《中华人民共和国职业分类大典》(以下简称“《大典》”)中的职业分类,其名称偏向书面化。为了保证搜索用词有效,本研究考虑了更多可能的搜索用词进行试搜索,并根据结果优化确定最终的搜索用词。确定搜索词的原则主要包括:(1)保证与《大典》中名称所指的职业类型相对应,保留足够具体的职业类型名称;(2)补充了生活中常用或搜索次数多的名称,如“科学研究人员”一项,加入了“科学家”这一百度搜索指数日均1000以上的词汇;(3)对于非常相似的称呼,使用该关键词在两个搜索引擎均有对应职业图片且搜索结果更多的名称;(4)对于部分过细的职业小类,采用其所属中类的类别进行整合搜索;(5)排除了《大典》中内涵复杂或现已不常用以及搜索结果中面部清晰的人像较少或结果多受到明显非该职业人物图片干扰的小类。最终保留的职业类别共132个,对应的搜索用职业名称共307个。

研究使用这307个搜索词在百度图片搜索[3]和搜狗图片搜索[4]进行搜索[5]。对于每个搜索词汇,保存了其搜索结果按网页排序的前100张图片,共61,400张。

(二)数据编码

本文以单张图片为单位,编码的变量主要是图片中主要职业工作者的性别。由于结果图片多有清晰度不足或多个职业工作者出现等情况,图片性别自动识别有一定困难,因此采用手动编码。具体地,我们首先识别图片中职业者人数,分为“单人”和“多人”;接下来对多人图片进行分类,标记为“单一性别”或“混合性别”;对于“单人”或“单一性别”的图片,男性标记为“0”,女性标记为“1”。为简化起见,本研究未包括“混合性别”的图片。[6]对于无法辨别图片中是否存在以及谁是职业者、无法辨别职业者性别的情况,均标记为缺失值。在去除4217张混合性别图片(百度2380张,搜狗1837张)和15,628个缺失值后,最终保留了132个职业共41,555张图片(其中百度20,828张,搜狗20,727张)用于分析。图片分别标记为男性(“0”)或女性(“1”)(两位编码员间信度系数Cohen's Kappa为0.92),以各职业下标记为女性的图片数量占比计算搜索结果中各职业性别比例。

三、研究发现

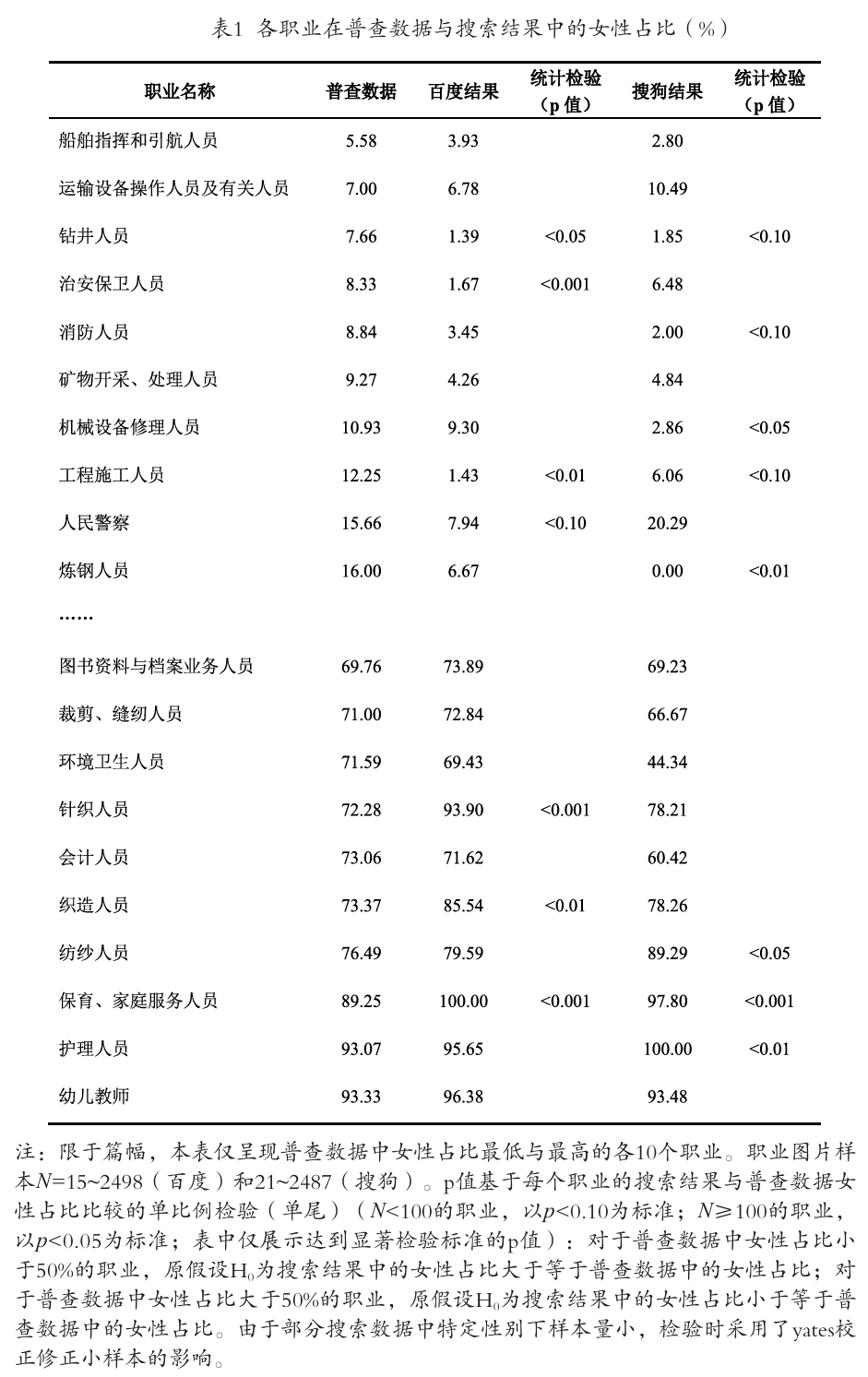

(一)各职业性别比例基本分布与差异检验

表1展示了132个职业的性别比例,以及图片搜索结果和现实数据对比的差异检验。根据普查数据,132个职业的女性占比范围从5.58%(船舶指挥和引航人员)到93.33%(幼儿教师),其中94个(占比71.21%)职业的女性占比低于0.50,均值为0.40(标准差SD=0.18)。而百度图片结果中132个职业的女性占比范围从0%(日用机电产品维修人员)到100%(保育、家庭服务人员),均值为0.36(SD=0.28);搜狗图片结果中132个职业的女性占比范围从0%(炼钢人员、地质勘探人员)到100%(护理人员),均值为0.33(SD=0.26)。

根据男性和女性占主导的不同职业进行的单尾差异检验,百度和搜狗图片搜索结果中均有71个职业类型的女性占比与普查数据存在显著差异,占职业总数的53.79%,呈现出对特定职业女性占比的夸大或缩小。例如,普查数据中医师(医生)的女性占比为43.57%,而百度和搜狗图片搜索结果中的女性占比分别仅为24.51%和29.58%(差异检验均p<0.001);普查数据中企业负责人的女性占比为25.07%,而百度和搜狗图片搜索结果中的女性占比分别仅为9.82%和2.36%(差异检验均p<0.001)。此外,普查数据中演员的女性占比为52.07%,而百度和搜狗图片搜索结果中的女性占比分别高达85.42%和80.81%(差异检验均p<0.001);普查数据中饭店服务员的女性占比为67.90%,而百度和搜狗图片搜索结果中的女性占比分别高达92.59%和88.59%(差异检验均p<0.001)。

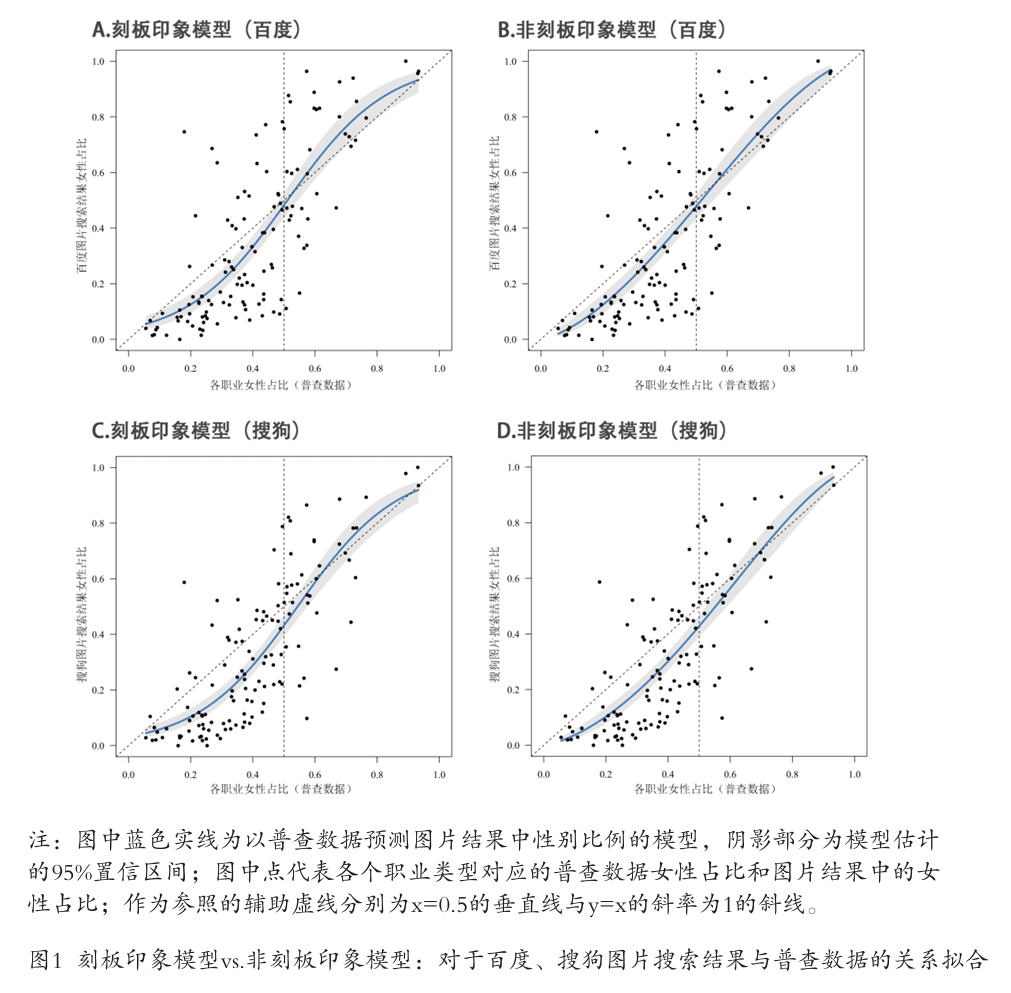

(二)职业性别刻板印象下的比例夸大与平台比较

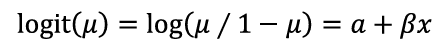

符合职业性别刻板印象的比例夸大意味着普查数据中女性占比高于50%的职业类型在图片搜索结果中的女性占比更高;反之,女性占比低于50%的职业类型在搜索结果中的女性占比更低。由于单独分类的差异检验难以反映不同性别占比职业中主导性别夸大程度的幅度变化,为更好地呈现职业中性别占比与搜索结果对该职业的性别夸大程度的关系,本文参考Kay等人(2015)的方法,通过刻板印象和非刻板印象的两个逻辑斯蒂回归的广义线性模型的拟合状况对比,检验是否存在刻板印象之下对职业性别比例的夸大。刻板印象模型是以普查数据中的女性占比预测图片搜索结果中的该职业女性比例的对数几率(即logit值),其公式为:

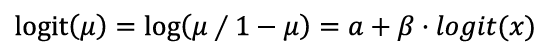

μ为响应变量y的分布期望,y符合准二项分布。广义线性模型中逻辑斯蒂回归的准二项分布族适用于本研究中响应变量为比例的数据,且准二项分布族预设的解释变量与响应变量的关系呈S型,作为刻板印象模型,体现出某性别占比高的职业在搜索结果中的性别比例夸大程度较男女人数均等的职业更高的形态。如果职业性别比例的普查数据与搜索结果的关系更拟合刻板印象模型,则说明搜索结果具有职业性别刻板印象下的比例夸大。而非刻板印象模型同样采用准二项分布的广义线性模型,但使用普查数据的logit值预测图片搜索结果中的性别比例的logit值,其公式为:

该模型的图像更接近直线,如果数据更拟合非刻板印象模型,则各职业的实际女性占比与该职业在图片搜索结果中的女性占比更接近线性关系,没有明显的刻板印象下的比例放大现象。

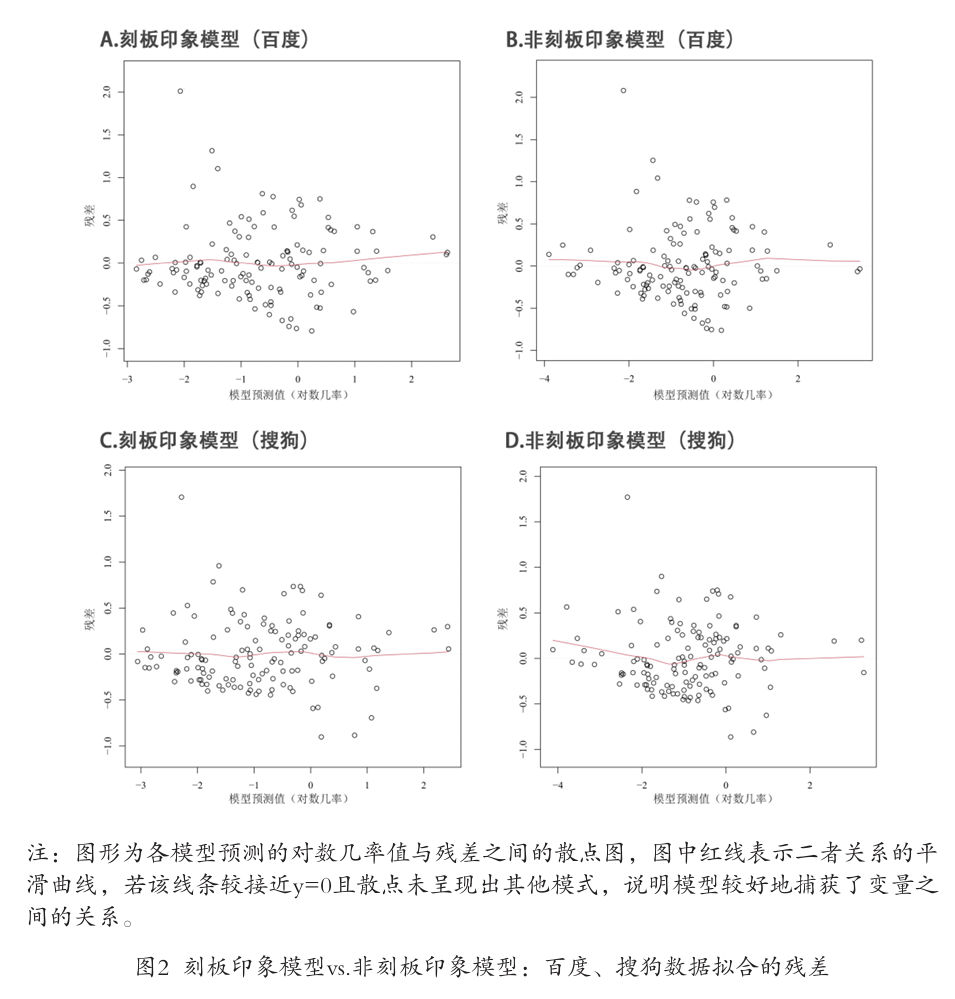

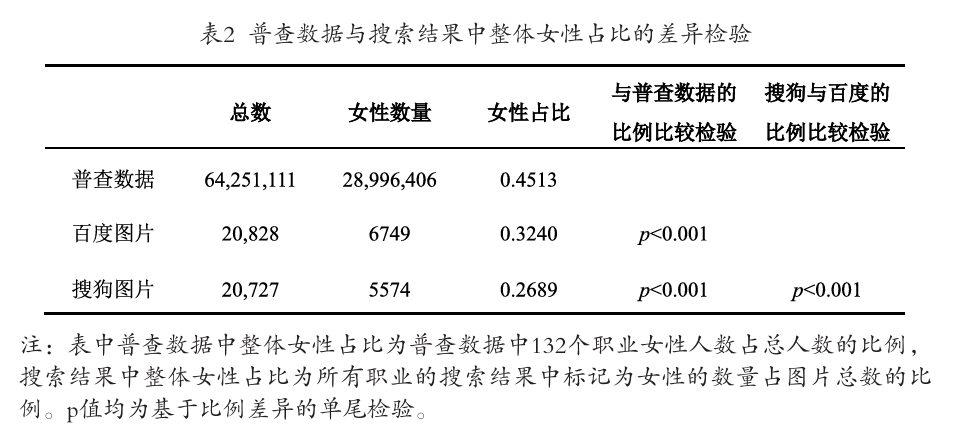

图1描绘了两个模型对于百度、搜狗搜索结果与普查数据关系的拟合状况。由图可见百度和搜狗的刻板印象模型拟合均呈S型,且在图片左下部分尤为明显,即实际女性占比低的职业在搜索结果中女性占比更加偏低。两平台两个模型的残差拟合图也显示(图2),无论对于百度还是搜狗,都是刻板印象模型对于残差拟合更好。根据数据与两模型拟合度对比的Vuong接近性检验,刻板印象模型均更加拟合搜索结果与普查数据的对比(p<0.01)。

因此,无论对于百度还是搜狗,刻板印象模型都更好地反映了其搜索结果与普查数据的对比状况。可见图片搜索结果中整体上存在着符合刻板印象的职业性别比例夸大,即假设1整体上得到证实,且对两个平台均成立。其中,对于女性占比低的职业,超过50%职业(百度58.51%[55/94],搜狗64.89%[61/94])的图片搜索结果中女性占比显著更低,存在按刻板印象夸大职业性别比例的情况,假设1.1基本成立;对于女性占比更高的职业类型,仅有少部分职业(百度42.11%[16/38],搜狗26.32%[10/38])支持假设1.2(搜索结果女性占比高于现实数据)。可见对于男性占主导的职业类型,搜索结果夸大性别刻板印象的现象更为凸显。

(三)性别占比系统性偏差与平台比较

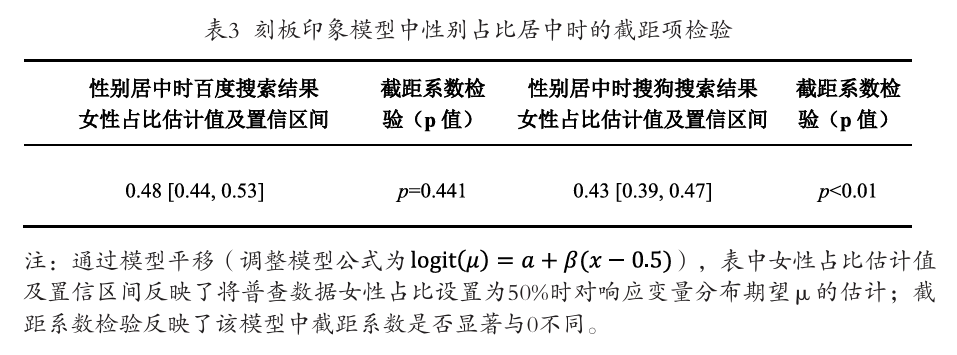

搜索结果也可能存在整体上的偏差,由表2可见,百度和搜狗搜索图片结果的女性占比都显著低于现实数据(p<0.001)。在平台对比中,搜狗图片的整体女性占比显著低于百度(p<0.001)。

考虑到前述分析已经发现大量男性主导职业中女性占比更低的问题,我们希望进一步探索除去低女性占比职业中的性别比例夸大,是否依然存在系统性的女性代表性不足的现象。我们根据刻板印象模型估计实际女性占比居中(即50%)的职业在搜索图片结果中女性占比的截距置信区间。若不存在搜索结果中性别占比整体偏高或偏低的情况,即便对于两性占比高的两端的职业存在着上述根据刻板印象夸大职业性别比例的现象,对于某个实际女性占比50%的职业,模型估计的图像搜索结果的女性占比也应该在50%左右。

如表3所示,百度模型截距不显著,其对居中职业的女性占比估计95%置信区间覆盖0.5,而搜狗模型的截距显著。这意味着:排除刻板印象下比例夸大的影响,性别居中职业在百度图片中的估计值不显著低于居中值,而在搜狗图片中的估计值依然体现出女性占比偏低的情况,即百度与搜狗的图片搜索结果中整体的女性占比都显著低于普查数据中的职业女性占比(假设2成立),但搜狗图片中女性占比系统性偏低的情况更严重。

(四)图片搜索结果中不同位置的职业性别比例差异

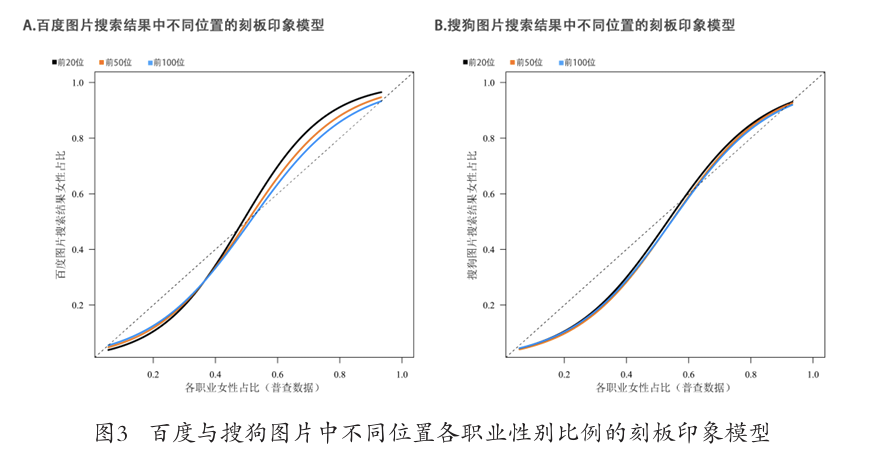

除了上述两平台各职业搜索的整体结果,本文还希望观察搜索结果中位于不同位置(前20、前50、前100)[7]的性别比例呈现有何差异。首先是符合刻板印象的比例夸大,图3展示了不同位置搜索结果与实际数据对比的刻板印象模型。在百度的3个模型对比中,从前20位到100位搜索结果的3个模型差距明显,图片位置越靠前,模型的S型越明显,即有着更夸张的符合职业性别刻板印象的比例夸大;而搜狗的3个模型没有明显差异。

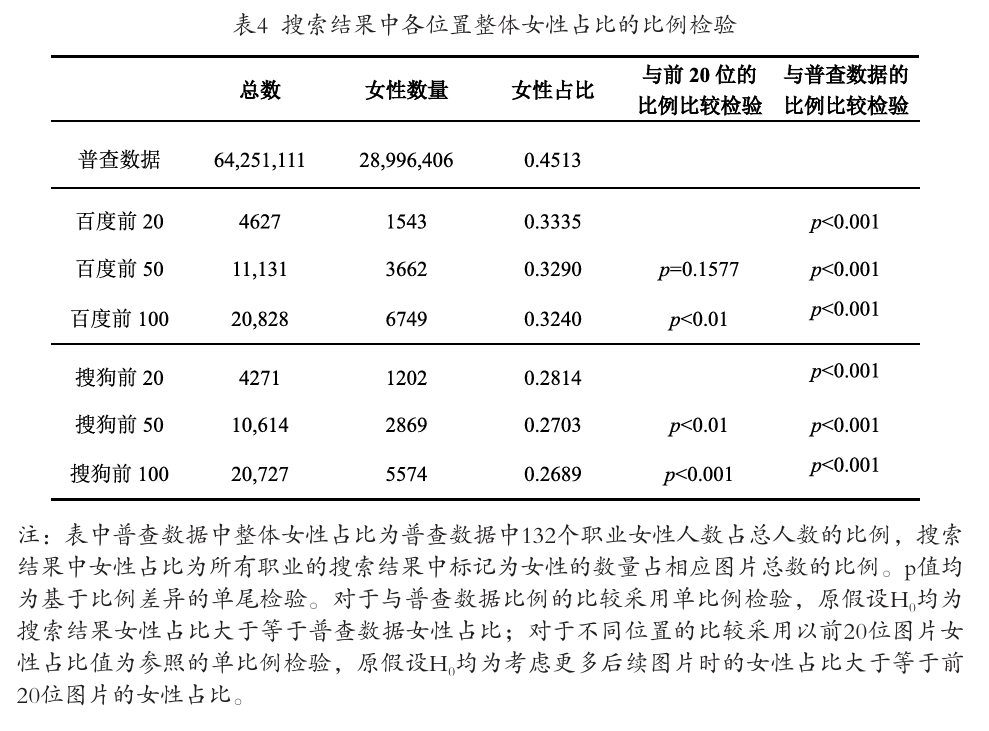

表4对比了处于不同位置的搜索图片的整体职业女性占比。结果发现:两个平台不同位置的搜索图片的女性占比均显著低于现实数据(p<0.001)。就不同位置之间的比较而言,百度前100位图片与前20位图片相比,以及搜狗前50、100位图片与前20位图片相比,女性占比都显著更低,即两个平台在整体女性占比较低的前提下,位置靠前的图片中女性占比略高。

因此,对于研究问题2,在按刻板印象夸大比例方面,百度搜索前20位图片的性别比例相对于后续图片更具有符合刻板印象的比例夸大倾向;在低度呈现女性方面,两平台各个位置图片皆存在整体职业女性占比偏低的情况,而靠前图片中职业女性含量相对略高。

四、结论与讨论

本文通过算法审计方式,对比搜索引擎各职业图片搜索结果中的性别比例与现实职业数据中的性别比例,考察中国主要搜索引擎图片结果中的职业性别刻板印象。研究发现:百度和搜狗两个搜索引擎的图片搜索结果都存在着反映职业性别刻板印象的比例夸大情况,尤其是对于女性占比较低的职业,图片搜索结果中女性占比更加偏低。与普查数据相比,百度与搜狗搜索结果的职业女性整体占比偏低,而搜狗图片搜索结果在排除比例夸大的居中职业上依然存在女性占比显著偏低的情况。刻板印象的比例夸大与女性的低度呈现在搜索结果的不同位置上普遍存在又有差异,与浏览更多图片相比,百度靠前页面符合刻板印象的性别比例夸大现象更加严重;在整体职业女性占比较低的前提下,百度与搜狗靠前页面中职业女性占比高于后续图片中的女性占比。

本文的主要贡献在于:第一,首次对中国本土的搜索引擎图片中的职业性别刻板印象展开算法审计实证研究,发现其中存在针对不同类型职业的性别刻板印象以及职业女性数量系统性不足的问题;第二,对百度与搜狗两个代表性搜索引擎进行跨平台比较,既发现了搜索引擎图片存在职业性别刻板印象的普遍规律,又刻画了二者在呈现刻板印象上的差异特征,如搜狗搜索结果中女性整体占比偏低;第三,本研究相较过去西方的职业性别刻板印象审计,进一步纳入搜索引擎的排序问题,发现搜索引擎靠前可能得到更多关注的图片中相对后续图片有更高的职业女性占比,而百度搜索靠前图片中的职业性别刻板印象更为明显。

作为数字空间的新型“策展者”(Thorson & Wells,2016),算法逻辑不同于以往大众媒介呈现的逻辑,它的运作调动着数据、代码与用户间的循环(Mehrabi et al.,2021),每个部分都可能成为刻板印象的来源。算法系统可能基于含有刻板印象的社会数据构建,其运行的结果则可能使用户继续接受并强化刻板印象(Baker & Potts,2013)。搜索引擎中的刻板印象并非技术系统凭空创造,而有其社会文化渊源。算法通过机器学习吸纳社会数据,词嵌入等技术基础逻辑内嵌于并折射长期的社会文化变迁(Garg et al.,2018)。例如,在中文中,“警察叔叔”“消防员叔叔”与“空姐”“保姆”等职业名称字面上就区隔出性别意涵,且彰显男性权力主导下的职业分工。即便真实的从业状况已然改变,简单的刻板印象却易于在语言中延续与传递(Beukeboom,2013),这一逻辑同样存在于图片视觉中。不断复制的职业性别刻板印象通过图像生产累积成数据,被算法系统不断吸收与编织。这一方面可能强化现实社会中的刻板印象,不利于性别平等、特别是女性的多元化职业发展,甚至在其求职就业时遭遇歧视;另一方面这种偏见将随着用户行为数据(包括在个性化推荐影响下)再次进入算法,导致刻板印象在人类与机器的循环反馈中持续与强化。

不能脱离社会文化与用户要求算法的公平公正,并不意味着算法系统可以无所作为。算法中蕴含的刻板印象首先应当在公共空间内被审计、被“可见”、被讨论。本文聚焦的搜索引擎,具有选择凸显部分内容、使之受到更多关注的不可小觑的权力(Graham et al.,2013;Steiner et al.,2022)。搜索引擎基于各自的利益关系与技术运作,形成不同的算法环境,带来差异化的搜索结果。但因其不透明,用户往往无法意识到其筛选与排序权力带来的操纵(Epstein & Robertson,2015);即便意识到搜索存在问题,也几乎无法作为个体反向控制搜索过程。正是在这个意义上,本文进行的“算法审计”,有利于将搜索引擎算法隐匿的职业性别刻板印象的公共问题呈现于公众面前。社会机构、团体和个人均可以从中反思自身习焉不察的刻板印象偏向,有意识地抵制强化此种偏向的社会性“输入”;算法平台更应主动承担对抗算法偏向的责任,对算法系统的学习过程进行规制,及时检查与改进面向用户输出的伤害性内容。以往研究已经表明,学术共同体或社会组织进行算法审计的压力对促进平台企业改善自身算法有一定效果(Simonite,2018;Raji & Buolamwini,2019),减少算法中的刻板印象并推动算法向善需要各方共同监督。

未来研究可以在如下方面继续深化:第一,本文仅考虑性别比例反映的职业性别刻板印象,而刻板印象也可能体现在单位图片内容的具体特征上,例如从业者的气质差别(Otterbacher er al.,2017)或性化程度(Ulloa et al.,2022)等,这些职业性别的视觉特质有待通过多模态分析进一步挖掘;第二,本文主要考察搜索引擎图片结果的职业性别刻板印象,未来研究可以拓展到社交媒体、大模型等其他算法过程中所蕴含的职业性别刻板印象,并进行比较研究;第三,本文主要运用抓取审计方法揭示职业性别刻板印象,未来研究可以进一步探索运用代码审计等其他审计方法以及通过进入算法平台企业进行深度访谈、田野观察等其他方法,深入挖掘搜索引擎呈现职业性别刻板印象背后的原因和机理。

注释:

[1]数据来自statcounter网站:https://gs.statcounter.com/search-engine-market-share/all/china。

[2]六普数据:https://www.stats.gov.cn/sj/pcsj/rkpc/6rp/indexch.htm。

[3]百度图片搜索:https://image.baidu.com/。

[4]搜狗图片搜索:https://pic.sogou.com/。

[5]检索时间:2022年7月25日至2022年8月1日。

[6]为验证结果的稳健性,本研究另外标记混合性别图片中的女性人数和总人数,计算该图片的女性占比,并根据该计算方法检验本文结果,发现与不包含混合性别图片的分析结果一致,即本文结论不受该数据处理方式的影响。

[7]指样本采集时所处的位置,尽管由于缺失职业和混合性别的样本去除,实际用于分析的图片数量可能少于相应位置的数值。

作者简介:

周葆华,复旦大学信息与传播研究中心研究员,复旦大学新闻学院教授,全球传播全媒体研究院研究员,复旦大学国家发展与智能治理综合实验室研究员;罗沛,复旦大学新闻学院博士生。

[引用格式]周葆华,罗沛。搜索引擎图片中的职业性别刻板印象——基于跨平台算法审计的研究,新闻大学,2024年第6期。

原文链接 | https://mp.weixin.qq.com/s/gKYplZ8k7r6ZhOkhybOg4w