作者:萨娜 发布时间:2026-05-13 12:15:27 来源:全球人工智能创新治理中心+收藏本文

编者按

人工智能(AI)已经进入美国联邦政府的日常运行工作。美国连续三届政府都将推动联邦机构采用AI视为提升行政效率、改善公共服务、增强国家竞争力的重要政策方向。布鲁金斯学会(Brookings Institution)于4月15日发布的文章《Assessing the state of AI adoption across the federal government》基于2023—2025年AI用例清单、联邦岗位数据、信息征询反馈以及对联邦技术人员的访谈等,系统梳理了美国政府在AI应用方面的进展与瓶颈。文章指出,公共部门AI应用的关键问题已不只是“能否部署”,更在于政府能否建立足够的人才储备、制度和公众信任基础,使AI真正改善公共服务。

以下译文仅代表原文作者的个人观点与分析立场。详细内容请参阅文末原文链接。

作者介绍

瓦莱丽·维尔沙夫特(Valerie Wirtschafter)为布鲁金斯学会研究员,任职于外交政策项目(Foreign Policy)及人工智能与新兴技术倡议组(Artificial Intelligence and Emerging Technology Initiative)。其研究关注人工智能治理、信息生态、技术政策及其对民主制度和公共治理的影响。

图片来源:报告页面

01

一

连续三届政府均支持推动联邦AI应用

过去几年,美国联邦政府内部AI应用已成为跨党派的政策重点。特朗普第一任期、拜登政府以及特朗普第二任期虽然在AI治理理念、监管重点和政治叙事上存在差异,但都强调联邦政府应当采用AI,以改善公共服务、推动数据驱动决策、提升国家竞争力并服务国家安全。

特朗普第一任期在2020年通过行政令将联邦AI应用置于更高优先级,要求各机构盘点AI用例、建立治理流程,并积极探索AI在政府业务中的应用。拜登政府随后在2023年行政令中延续并扩展这一方向,增加了风险评估、报告义务以及针对“影响权利”和“影响安全”的AI系统的管理要求,同时推动AI技术和相关赋能人才的招聘。特朗普2025年重新执政后,虽然撤销了拜登政府2023年的AI行政令,但白宫管理和预算办公室后续备忘录保留了不少类似的制度安排,包括首席AI官、采购改革和AI用例清单等。

2025年7月,美国政府发布《美国AI行动计划》(America’s AI Action Plan),进一步强调AI对于建设更加灵敏、响应性更强的政府的积极作用。与此同时,“政府效率部”(Department of Government Efficiency,DOGE)的设立,也将“利用现代技术”打击浪费、欺诈和滥用作为行政改革叙事的一部分。文章指出,这些行政令、白宫管理和预算办公室(Office of Management and Budget,OMB)备忘录和行动计划共同推动联邦机构加快AI应用,尤其强调与私营部门合作,并简化采购流程。

二

AI用例快速增长,相关应用已进入关键公共职能

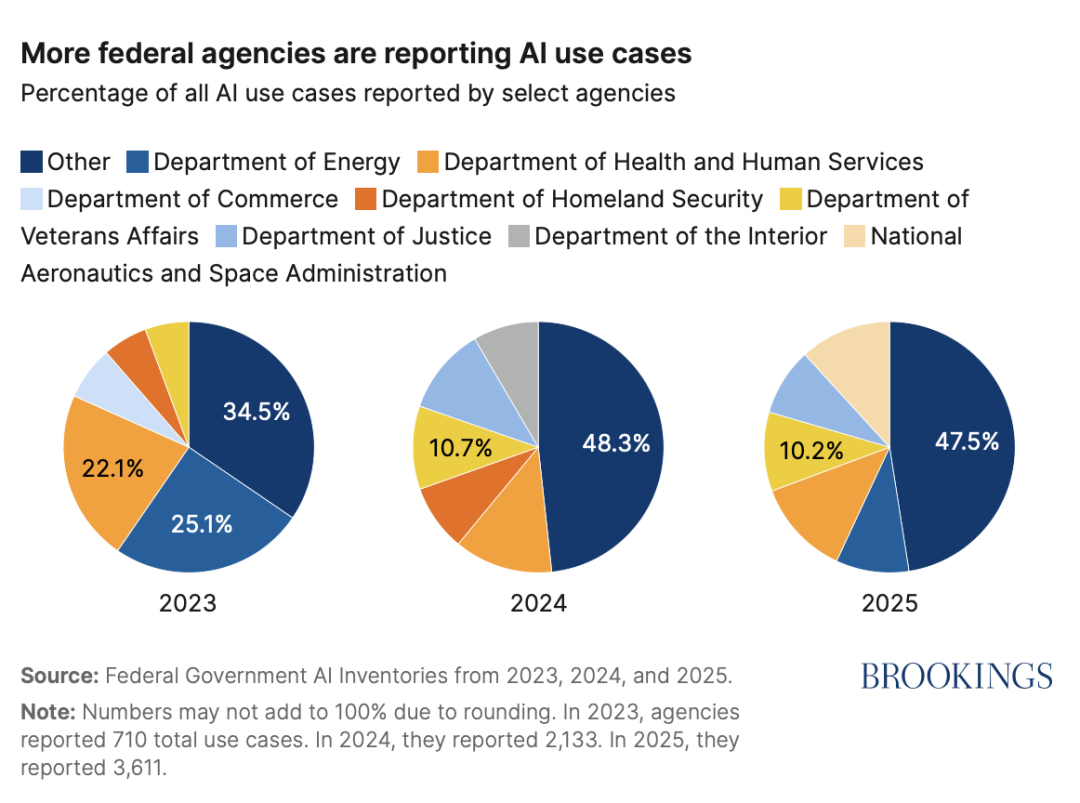

从公开清单来看,美国联邦机构AI应用规模近年来明显扩大。2025年,41个联邦机构共报告超过3600个AI用例,比2024年增加69%,约为2023年的五倍。文章提醒道,这一增长部分可能来自OMB报告指南更加明确,使机构更清楚哪些项目需要纳入统计;但从总体趋势看,它也反映出AI确实正在更广泛地进入联邦政府业务。

越来越多的联邦政府机构开始应用AI

图片来源:报告原文

相关AI用例并不仅限于后台行政流程。许多项目确实服务于内部管理、数据整理、文书处理和运营优化等,但也有不少应用已经进入任务关键领域,包括福利发放、医疗健康服务和执法。以社会保障署为例,在其2025年报告的AI用例中,52%用于服务交付和政府福利处理。国土安全部和司法部报告的AI用例中,分别有36%和54%用于支持执法相关工作。卫生与公众服务部和退伍军人事务部报告的AI用例中,分别有20%和45%用于健康与医疗服务。

三

大型机构主导扩张,而中小机构能力有限

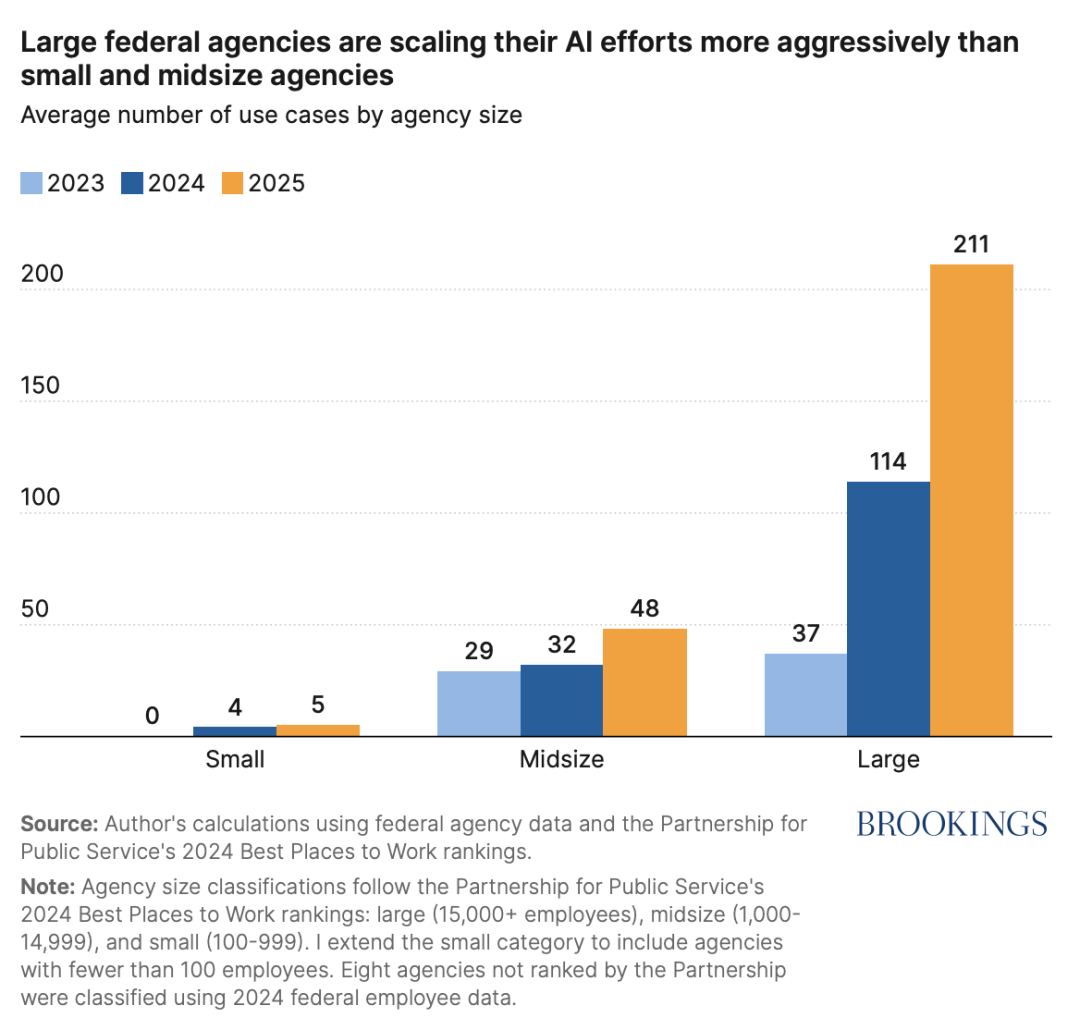

尽管参与AI报告的机构数量增加,但AI应用规模在不同机构之间的差异也较为明显。2023年,共有21个机构提交AI用例,其中包括13个大型机构和8个中型机构,没有小型机构参与。到2025年,参与机构增加至41个,包括13个大型机构、17个中型机构和11个小型机构,说明更多机构开始意识到AI的潜在作用,也开始尝试将其纳入业务场景。

不过,AI应用规模仍高度集中于少数大型机构。过去三年,五个大型机构贡献了AI用例清单中超过一半的报告用例。2024年,大型机构占全部AI用例的69%;到2025年,这一比例进一步升至76%。相较之下,中型和小型机构的合计占比从31%降至24%。从单个机构平均用例数看,2025年每个大型机构平均报告211个AI用例,中型机构平均48个,小型机构仅平均5个。11个小型机构合计提交60个用例,只占全部清单约2%。

大型机构主导AI应用的扩张

图片来源:报告原文

这种差距既与机构职能不同有关,也反映出不同机构间资源和能力的不均衡。大型机构拥有更多预算、数据、技术人员和试验空间,更容易将AI从零散试点推进到规模化使用;中小机构虽然也在尝试,但常常缺少足够的技术基础、采购经验和内部人才。文章认为,这种不均衡可能会影响联邦政府整体AI能力的扩张。

四

高影响AI用例增加,但风险分类信息仍不完整

AI用例清单还提供了观察风险治理的重要窗口。2024年,拜登政府要求机构详细报告“影响权利”或“影响安全”的AI系统,即那些会控制或显著影响个人结果的AI应用。特朗普政府随后将相关要求调整为“高影响”用例,即AI被用作相关结果“主要依据”的情形。2024年,影响权利或安全的用例占全部清单的16.5%,共351项;2025年,高影响用例占全部清单的12.3%,共445项。虽然比例下降,但绝对数量有所增加。

由于部分用例缺少统一标识符,研究者很难准确判断机构是否只是将原有“影响权利或安全”的用例重新分类为“高影响”,还是改变了判断标准。在可通过机构和名称匹配的1000多个2024和2025年用例中,85%曾被标记为影响权利或安全的用例,在新框架下仍保留高影响分类。这说明不同政府之间对部分AI风险的判断仍有一定连续性。

此外,还有一些调整值得关注。2024年至2025年间,有32个用例被降级,其中包括9个司法部执法用例,如利用机器学习在联邦调查局外地办公室进行分流、支持调查等。多数降级理由是AI并未构成决策的“主要依据”。与此同时,也有8个用例首次被列入“高影响”用例当中,包括与医疗账单和诊断决策相关的应用。

更重要的问题在于透明度。理论上,一旦某项AI应用被列为“高影响”用例,机构就应提供部署前测试、影响评估、监测机制或申诉流程等与风险控制相关的信息。但实际情况并不理想。2025年,在已部署的“高影响”AI用例中,超过85%缺少部分必要的风险控制信息。对于已经进入福利、执法和医疗等领域的系统而言,这类信息缺口会直接削弱公众对政府AI应用的信任。

02

一

AI人才仍只是联邦技术队伍中的小部分

联邦政府要有效应用AI,必须具备足够的技术人才。过去十多年,美国政府一直在尝试扩大公共部门技术人才队伍,然而,其技术岗位招聘长期面临多重障碍,包括招聘周期过长(特别是涉及安全审查的岗位)、对申请者需要熟悉复杂的联邦招聘规则的要求、职业晋升空间有限、公共部门薪酬相较私营部门缺乏竞争力等。

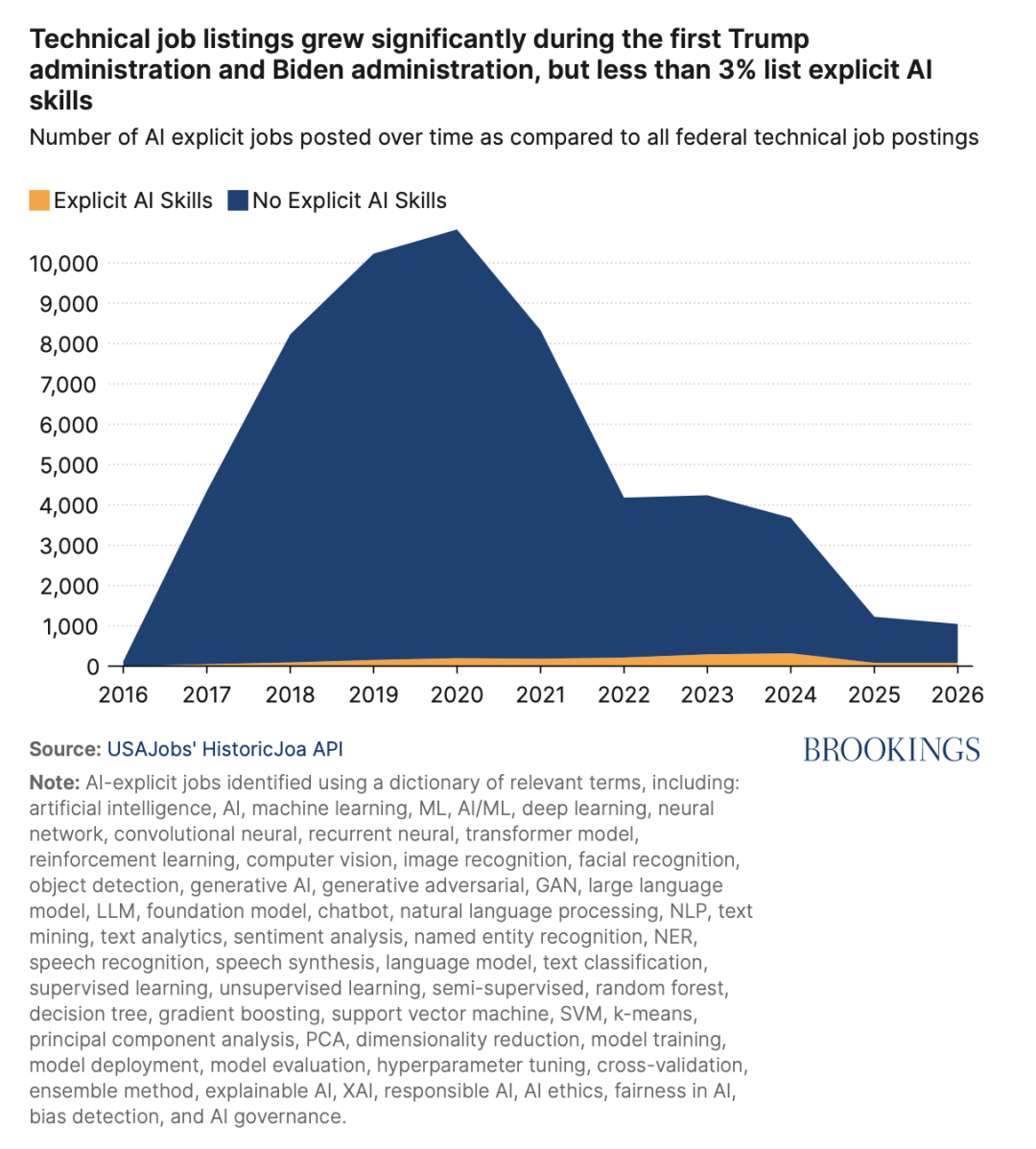

从岗位数据看,2016年以来,美国联邦政府发布了超过5.6万个技术岗位。但其中明确涉及AI和AI赋能能力的岗位只有1600多个,略低于3%。虽然AI相关技术岗位在近年来有所上升,从2016年的零增长到2024年约占全部技术岗位的8%,2021年至2024年相关岗位数量也从184个增加到318个,但这一比例相对于联邦政府整体需求仍然很小。

技术性岗位在增加,但直接与AI相关的岗位占比很低

图片来源:报告原文

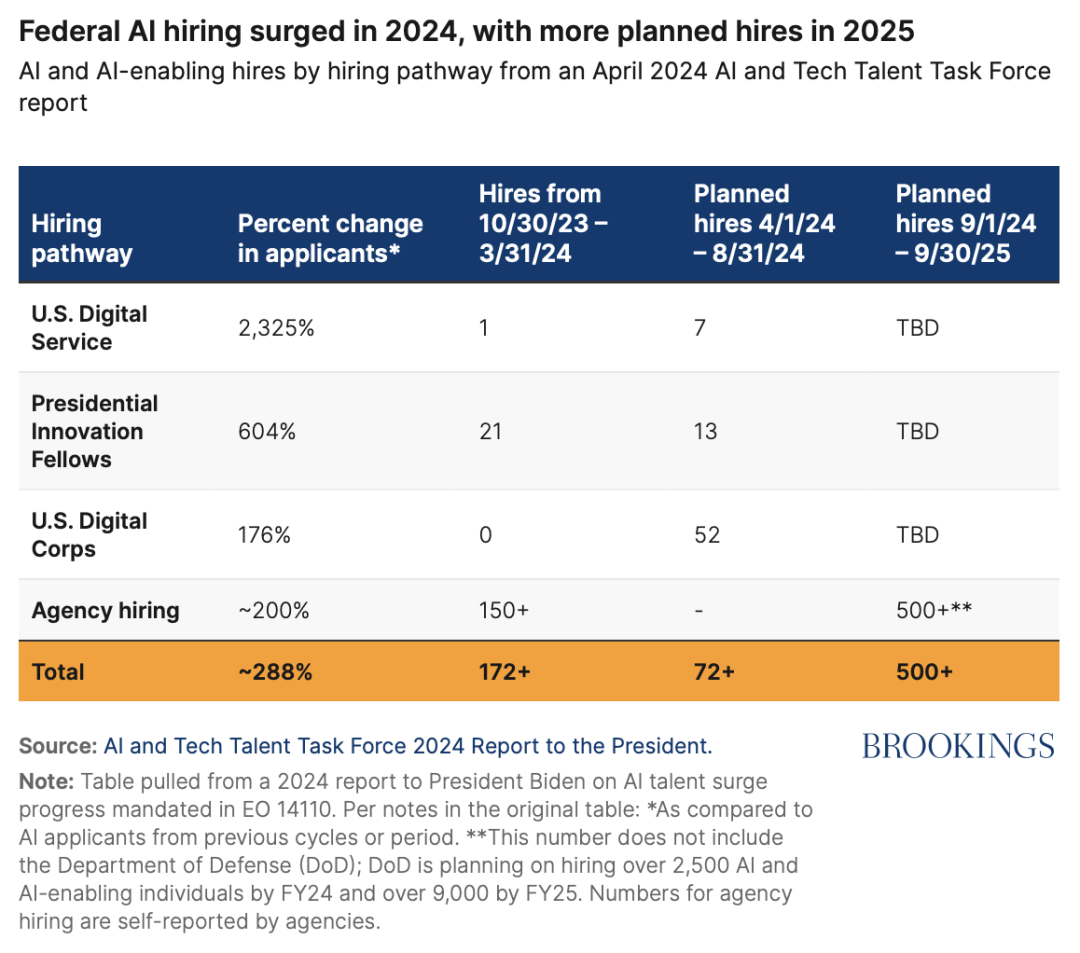

拜登政府曾通过2023年行政令启动AI人才激增计划,强调政府需要能够构建、训练和测试AI模型,评估AI社会影响,管理和监测AI项目,培训AI赋能型劳动力,并理解AI误用的法律影响。早期数据显示,该计划预计到2024年夏季为联邦政府引入约250名人才,并计划在2024年9月至2025年9月之间再招聘500人。

不过,2025年以来,随着特朗普第二任期削减联邦雇员,AI相关招聘出现下降。文章指出,自2025年初以来,联邦政府仅发布160个明确要求AI专业能力的全职岗位。一些原本旨在加速AI应用的岗位发布甚至没有提及AI或技术,这可能缩小申请者范围,阻碍真正具备能力的人才进入政府。与此同时,2025年初的联邦人员削减可能影响了不少刚被招聘进政府的AI和技术人才。由于部分员工尚处于试用期,较容易被解雇,公共报道中美国数字服务人员离开以及18F被削减的情况,也显示出联邦政府可能正在失去部分关键技术能力。

2025年预计联邦政府AI人才雇用情况

图片来源:报告原文

二

短期项目有助于人才引入,但难以替代长期能力建设

为弥补技术人才缺口,美国政府近年来尝试过多种短期或固定任期人才项目,例如总统创新研究员(Presidential Innovation Fellows)、数字军团(Digital Corps)、美国技术部队(U.S. Tech Force)等。这些项目可以从私营部门、科研机构和社会组织引入技术人才,让他们在一定期限内服务联邦政府,为具体项目提供专业能力。特朗普政府还宣布设立固定任期的美国技术部队,希望从产业界等渠道引入人才,在联邦政府服务两年。

这些项目对于公共部门创新生态具有重要价值。它们可以在短时间内补充政府所缺少的技术知识,也能帮助机构启动原本难以推动的数字化项目。然而,文章强调,短期项目不能替代长期能力建设。政府AI应用需要稳定的内部技术人员,这些人员需要能够理解机构使命、与数据相关的限制、采购流程和监管要求,并在短期人才离开后保留机构记忆。如果缺少职业公务员体系中的技术晋升通道,政府就很难长期留住AI人才,也难以形成持续监督承包商和管理复杂系统的能力。

因此,固定任期项目应被视为补充机制,而不是核心解决方案。更关键的是要改革公务员技术岗位招聘,降低过度依赖学历和僵化岗位分类的门槛,转向基于技能和经验的评估,并为技术人员建立真正有吸引力的职业发展路径。

三

风险规避文化限制试点扩展

即使技术人才进入联邦政府,也会面对高度层级化、倾向于风险规避的组织环境。在这种环境下,高层领导对AI应用成败具有重要影响。受访技术人员指出,成功扩大试点项目的关键条件之一,是得到主管明确授权,拥有可以试验和犯错的空间。在拜登政府和特朗普政府时期,来自白宫的政策指令也在一定程度上为技术人员创新提供了政治保护。

但领导层支持并非总能获得。有些高级官员对AI感兴趣,却缺少预算,无法从更紧迫的任务中调配资源;有些领导并不了解相关技术,也没有时间深入学习。若技术人员无法确信领导层会支持试验,他们往往会选择更安全、更传统的做法。文章指出,当前可获得部署状态信息的用例中,近60%仍处于试点或部署前阶段,说明联邦AI应用虽然增长迅速,但尚未真正进入成熟部署阶段。

“政府效率部”将AI部署与联邦人员削减相联系,也可能进一步加剧机构内部的保守倾向。理论上,AI可以把公务员从重复性工作中解放出来,使其转向更复杂、更具判断性的任务;但如果机构员工认为AI应用会被直接用于裁员,反而可能降低其参与和配合意愿。

四

承包商依赖凸显内部能力问题

AI热潮还与美国联邦政府长期依赖外部承包商的采购环境相叠加。2025年多数AI用例没有提供开发方式信息;在提供相关信息的1600多个用例中,约63%由承包商单独开发,或由承包商与内部资源共同开发。对于尚未部署的项目,内部开发和承包商开发大致各占一半;但当项目进入完全部署阶段,承包商参与比例升至72%,纯内部开发比例则降至28%。

这一现象可以有两种理解。一方面,近年来政府内部能力有所提升,新项目在原型开发和早期测试阶段更多依赖内部团队;另一方面,也可能说明政府在将试点项目扩大为成熟系统时仍面临困难,最终不得不依靠外部供应商完成部署和运维。无论哪种解释成立,文章都强调,政府必须具备足够的内部技术能力,才能有效监督供应商、评估系统风险,并在必要时自主开发或维护关键能力。

对公共部门而言,承包商参与本身并不必然构成问题。真正的问题在于政府是否拥有足够的“聪明买方”能力,能够知道自己购买的是什么、系统如何运行、风险由谁负责、出现错误时如何追责。如果政府只负责签约和验收,而缺乏持续技术判断,AI应用就容易变成能力外包和责任模糊的结合体。

03

一

黑箱问题提升公共问责难度

与传统软件、数据库和云服务相比,AI系统的动态性和不透明性给公共问责带来了更大挑战。传统数据库查询若出现异常结果,管理员通常可以逐步追踪逻辑,查明错误来自数据、规则还是操作流程。但当AI系统建议拒绝某人福利申请,或将某人标记为调查对象时,其推理过程可能更难解释,也不一定能够稳定复现。即便关于AI可解释性的研究在不断推进,许多系统仍存在所谓“黑箱问题”,即开发者自身也未必能完全说明系统为何得出某一结果。

在公共部门,这种不透明性比在商业场景中更敏感。政府决策会影响个人权利、福利资格、执法对象和公共资源分配。若AI系统参与这些决策,却无法解释、审计和纠错,行政问责链条就可能被削弱。文章因此指出,AI系统越复杂,联邦政府越需要具备AI技术和AI赋能人才,使其能够理解系统限制、监督模型表现,并在出现问题时提供可核查的解释。

二

预算周期难以匹配AI技术变化速度

AI发展速度也使传统政府预算流程稍显滞后。过去政府采用新技术时,往往可以在多年周期内规划、试点和扩大部署,并较有把握地预期底层技术在一段时间内保持稳定。但AI能力变化很快,模型、专利和论文数量迅速增长。一个今天启动的试点项目,可能在尚未规模化之前就已经落后,或者被能力更强的新系统替代。

然而,美国联邦预算流程通常在财政年度开始前一年半就启动,要求机构提前预测资金和技术需求。对于快速演进的AI而言,这种预测很难做到准确。AI项目还需要额外的灵活预算,用于人员、工具开发、采购、测试和迭代。若预算机制过于僵硬,机构就难以响应技术变化,也难以将早期试点及时转化为可持续的系统。

技术现代化基金(Technology Modernization Fund,TMF)在一定程度上提供了更灵活的资金渠道。该基金由总务管理局和OMB管理,2017年设立时获得2.5亿美元授权,后又通过《美国救援计划》(American Rescue Plan)获得10亿美元追加拨款。该基金已支持34个机构的60多个项目,并曾支持5100万美元AI赋能项目,包括向商务部AI安全研究所提供1000万美元、向国务院提供1820万美元用于生成式AI外交应用等。

不过,TMF也存在申请程序繁琐、文件要求过多、多年实施计划负担较重、还款机制不确定等问题。文章认为,尽管该基金并不完美,但其短期授权中断已经暴露出一个关键问题,即政府需要比传统预算路径更灵活、更稳定的共同资金机制以支持AI应用。

AI风险管理框架:从技术部署到公共问责

图片来源:美国国家标准与技术研究院网站页面

三

既有采购与合规规则难以适配AI迭代

AI系统的快速更新也给既有法律和监管框架带来了挑战。许多联邦技术规则最初是围绕相对静态的软件和云服务设计的,后者更新频率较低,变化较可预测。但AI系统与之不同,往往需要持续测试、反馈和微调。若制度仍以一次性授权、阶段性审查和固定规格采购为基础,就可能难以适配AI系统的实际生命周期。

文章列举了几个典型制度。联邦风险和授权管理计划(Federal Risk and Authorization Management Program,FedRAMP)主要用于云服务安全授权,其流程往往以前置性、一次性授权材料为核心。运行授权(Authorization to Operate,ATO)通常在某一时间点安全评估后授予,系统发生重大变化则可能触发相关条件以进行重新评估。联邦采购条例(Federal Acquisition Regulation,FAR)规定政府如何采购信息技术和其他产品服务,但复杂流程可能无法适配于快速迭代的采购对象。

此外,《文书削减法》(Paperwork Reduction Act,PRA)也可能会影响AI系统地学习和改进。该法律本意是通过要求某些调查、表格和数据收集活动提前获得OMB批准,并进行公告和意见征询,以减轻联邦政府向公众收集信息的压力,但审批时间可能长达六至九个月,而对于需要通过用户反馈快速改进的AI系统而言,这一周期显然难以匹配技术迭代需求。

04

一

公众对AI的担忧正在上升

联邦政府AI应用面临的另一个重要挑战,是美国公众对AI本身的不信任。皮尤研究中心(Pew Research Center)数据显示,约一半美国人表示,他们对AI日益普及感到担忧多于兴奋,这一比例四年前为37%。只有17%的美国公众认为AI将在未来20年对美国产生积极影响。

这种信任基础对公共部门尤其重要。商业产品中的AI应用若出现问题,消费者可以更换服务;但政府AI系统关系到福利、执法、医疗、出入境和税务等各个公共事项,个人未必有现实选择空间。因此,一旦政府在高影响类服务或惩罚性用途上部署AI,就必须面对更严格的问责解释、透明度和权利保护要求。文章指出,在公众本已持怀疑态度的背景下,任何高调的联邦AI项目都需要克服额外的信任压力。

美国缺少中央政府层面的AI立法,也可能会进一步削弱公众信心。特朗普政府试图优先推进AI发展并限制州层面监管,加上社会对超级智能系统可能带来极端风险的讨论,可能会使得公众倾向于认为AI发展缺少足够护栏。无论这些担忧是否有确切的依据,如果公众已经持有怀疑态度,就更难相信政府仅凭行政承诺就能保证自动化系统能够服务于公共利益。

二

高风险领域透明度不足会削弱信任

公众怀疑还会被具体治理缺口放大。正如前文所述,2025年部分高影响AI用例虽然已经得到部署,但相关风险控制信息还并不完整。若相关机构在执法、医疗、福利等敏感领域使用AI,却没有充分说明其测试、评估、申诉、监测和纠错机制,公众就难以判断这些系统是否安全、是否公平、是否可被追责。

公共信任来自服务体验

图片来源:美国运输安全管理局

三

大语言模型政治化增加政府采购争议

大语言模型的政治化争议也会影响政府AI应用。文章指出,大语言模型为联邦雇员提供支持具有巨大潜力,定制化工具,如State Chat和USAi,已经投入使用。但与此同时,模型存在政治偏见的问题正日益成为特朗普政府关注的焦点,例如后者近期的行政令包含限制采购内置“意识形态偏见或社会议程”的模型,五角大楼也曾认为前沿模型开发商Anthropic存在与意识形态等相关的“供应链风险”。

文章指出,讨论大语言模型的政治偏见并非毫无意义。随着AI系统越来越多地嵌入搜索引擎、手机和公共服务当中,追求某种意义上的中立并非不合理目标。然而,真正完全中立的系统几乎不可能构建。开发者可以尽力接近中立,但如果政府将“反偏见”的要求选择性地适用于某些供应商,或把一个政治光谱上的偏见替换成另一个政治光谱上的偏见,就会进一步损害公众信任。

文章还提到,五角大楼与xAI的合作,以及xAI争取FedRAMP High授权的努力,可能削弱相关行政令的精神。xAI由埃隆·马斯克拥有,其更新的模型曾被认为反映创始人的政治偏好,近期还因生成儿童性化图像引发机构担忧。这些争议可能使部分公众更加怀疑政府在联邦机构,尤其是涉密环境中如何选择和部署AI系统。

四

公共服务仍需要人际互动

除了政治争议,公众还普遍担心AI可能会替代人际互动。研究显示,人们在面对后果重大或判断较主观的事项时,更倾向于与人打交道,而不是与自动化系统互动。这一点在政府服务中尤其明显。

文章提到,一项针对1.3万多名航空旅客的调查发现,公众对运输安全管理局的印象改善,并不主要来自面部识别技术的广泛应用,尽管该技术有助于减少等待时间;真正重要的因素是TSA工作人员人际沟通的改善。换言之,技术可以帮助减少机场安检中重复、繁琐的工作,使工作人员有更多精力与旅客沟通,而公众信任的来源则是被尊重、被理解和被妥善对待的体验。

05

文章认为,若要以负责任方式推动联邦AI应用,美国政府需要在三个方向同时发力:扩大技术人才支持和AI素养建设,解决阻碍技术现代化的基础制度障碍,并通过高透明和高价值应用建立公众信任。

一

扩大技术人才支持与AI素养建设

首先,应明确固定任期技术人才项目的定位和边界。美国政府已有多个面向技术人才的“服务期”项目,包括美国技术部队、总统创新研究员、美国DOGE服务、数字军团以及已经停止运作的18F。各项目应清晰地说明自身目标、服务期限、岗位性质和人才需求,确保合适的人才进入合适的申请渠道。同时,短期人才在政府和私营部门之间流动时,也应处理好真实或潜在的利益冲突。

其次,应继续改革公务员技术岗位招聘方式。固定任期技术人才项目很重要,但职业公务员体系中的技术人员才是长期能力建设的基础。他们能够把创新项目与机构实际相连接,理解采购限制、业务流程和数据环境,也能在一批批短期人才离开后保留实践经验。政府可以设立专门团队评估技术岗位申请者能力,减少过度依赖狭窄学历要求和不匹配岗位分类的做法,转向基于实际技能和经验的招聘。对于AI技术和AI赋能岗位,政府还应继续使用并扩大直接招聘权限。岗位描述若是为了促进AI应用,就应明确提及AI或技术,否则合格申请者可能根本不会投递。

再次,应为公务员技术人员建立真正有意义的职业通道。留任奖金可以短期留住人才,但不能替代晋升空间和职业认同。若政府希望提高机构整体技术素养,就需要为技术人员提供类似其他专业岗位的晋升路径。文章还建议拓展技术政策或“桥梁型”角色,让有经验的技术人员进入政策、监督和执行团队,在保持实践能力的同时参与规则制定和监管执行,以便让更多真正理解技术约束和风险的人参与政策过程。

此外,AI素养应成为公共部门核心能力。面对AI快速发展和与之相对的联邦雇员对AI工具部署的犹豫情况,政府应建立分层AI素养培训体系,根据不同岗位设计不同内容。技术专家需要持续更新专业知识,高层领导需要理解AI能力、局限并做出取舍,普通公务员则需要掌握AI基本伦理、风险和适用场景。文章建议借鉴劳工部的AI素养框架,将AI学习变成一项持续的、制度化的工作,并为员工参与培训提供专门时间和激励。AI素养建设也不应只面向新员工,也应面向现有队伍,并纳入年度绩效评价。

最后,应系统记录和分享AI应用的成功案例与经验教训。随着各机构积累的AI应用经验越来越多,跨机构知识共享可以帮助减少重复试错,尤其能支持资源较少的小型机构。作者建议在AI.gov上建立面向公众的案例库,展示不同机构的新颖应用。这不仅有助于机构间学习,也能向公众说明政府内部并非缺少创新,并可能增强技术人才加入政府的兴趣。

美国总务管理局推动联邦AI应用基础设施建设

图片来源:美国总务管理局网站页面

二

进一步解决技术现代化面临的制度障碍

推动AI应用还需要处理更基础的技术现代化制度障碍。文章建议,政府应继续推进采购改革,并重新审视与技术采用相关的规则和监管要求。安全仍应是联邦技术系统的核心优先事项,但政府也需要让测试、部署和维护AI系统的工作在程序和技术层面更加顺畅。

部分改革已经启动。例如,FedRAMP 20x旨在加快FedRAMP批准流程,减少部分繁琐环节,包括机构赞助和政府专属产品要求。但除FedRAMP外,FAR、ATO和PRA等制度也被认为是AI应用障碍。它们最初面向以静态为主的软件产品,而当前AI系统的开发速度更快、更新频率更高、反馈机制更复杂。因此,政府应与国会合作,对相关制度做出评估,以适应动态的AI发展。

预算机制同样需要改革。AI发展难以预测,试点和规模化需要更灵活的资金,但现有正式预算周期往往过长。文章建议,联邦机构应与国会合作,探索更灵活的拨款方式,缩短计划和资金之间的时间差,同时纳入防止滥用的机制。国会还应继续支持技术现代化基金或类似的灵活资金工具,并让申请程序更易操作、遴选过程更加透明,以鼓励更多机构参与。

三

通过高透明与高价值应用重建公共信任

首先,公共信任建设是联邦AI应用能否持续推进的关键。文章建议,首先应强化并协调现有透明度实践。AI.gov过去曾是联邦AI活动的集中入口,提供按机构划分的首席AI官名单、合规计划和AI用例等信息。但该网站后来更多转向发布讲话、行政行动、情况说明和文章等,已不再集中展示各机构AI活动。作者建议AI.gov重新扩展功能,公开各机构如何落实相关指导,并保留当前和历史文件,为国会和公众提供一处容易访问的联邦AI监督与应用记录。

其次,应弥补AI指导中的隐私缺口。美国政府问责局(Government Accountability Office,GAO)近期报告指出,OMB提供的AI指导并未充分解决机构使用AI时涉及的隐私问题,尤其是与敏感数据相关的风险。GAO建议OMB识别并共享机构AI政策应处理的已知隐私风险,促进隐私最佳实践、模型审计方法、敏感数据保护等方面的信息交流。文章认为,采纳这些建议将为机构管理隐私风险提供更明确方向,也有助于提升公众对联邦AI应用的信心。

再次,应维护并改进联邦AI用例清单。该清单始于特朗普第一任期,为公众了解不同机构如何理解和推进AI应用提供了重要窗口。至少在OMB整合发布用例时,应保留统一的用例标识符,以便研究者和公众比较项目随时间变化的情况。机构也应尽可能具体地描述用例,同时承认部分机构出于使命和风险原因可能会对可公开信息做出限制。对于高风险或高影响用例,OMB应鼓励机构完整说明其风险控制实践,因为这些项目最可能引发公众担忧,而目前相关信息即使系统已经投入运行的情况下也常有缺失。

此外,政府应尽量减少大语言模型在政府应用中的显性政治化。如果联邦政府执行关于降低大语言模型政治偏见的行政令,OMB和GSA应确保要求被均衡适用,而不是把一种政治倾向的偏见替换为另一种倾向的偏见。否则,政府AI应用的公信力可能会进一步下降。

最后,联邦AI投资应优先注入能够明确改善民众生活的高价值应用。在推进低风险后台系统提高效率的同时,政府应优先支持能够简化公民与政府互动的项目,例如税务服务、福利导航、就业和培训匹配、极端天气预测、疫情监测等,以及处理部分对人力要求过高的数据密集型任务。政府应谨慎对待惩罚性或高风险AI部署,对于这类用例,相关风险控制和保护机制的透明披露尤为重要。

原文链接

https://www.brookings.edu/articles/assessing-the-state-of-ai-adoption-across-the-federal-government/